Puntos Clave

- La RAM es el factor limitante, no la CPU: sin mínimo 32 GB de memoria, el rendimiento en modelos de IA profesionales es insuficiente.

- La memoria unificada lo cambió todo: Apple Silicon M4/M5 y AMD Ryzen AI han eliminado la necesidad de GPUs dedicadas voluminosas para la mayoría de casos de inferencia.

- Privacidad como ventaja competitiva real: ejecutar IA de forma local garantiza que tus datos y propiedad intelectual no salgan de tu red, algo que ningún servicio en la nube puede igualar.

Nota de transparencia: Algunos de los enlaces son links de afiliados de Mercado Libre. Si compras a través de ellos, Rallynomics recibe una comisión que ayuda a mantener este laboratorio de pruebas, sin costo extra para ti.

¿Por qué 2026 es el año de la IA local?

Tres factores convergieron para que la IA local deje de ser un experimento y se convierta en infraestructura viable:

1. Arquitecturas de memoria unificada: Apple Silicon M4/M5 y los AMD Ryzen AI 300/400 permiten que la RAM del sistema actúe como VRAM de alta velocidad, eliminando el cuello de botella histórico entre CPU y GPU. Si quieres entender cómo este cambio de silicio impacta el hardware de consumo, nuestro análisis sobre Apple Silicon M4 vs Snapdragon X Elite detalla la arquitectura detrás de ese salto.

2. Modelos open source optimizados: Llama 3.3, Qwen 3 y DeepSeek V4 demostraron que no se necesitan billones de parámetros para obtener resultados profesionales en codificación, análisis de documentos o agentes autónomos.

3. Presión de privacidad: las empresas y profesionales ya no están dispuestos a enviar secretos comerciales a servidores remotos. Como analizamos en nuestro artículo sobre el colapso del modelo freemium en IA, las suscripciones en la nube tienen un costo estructural que la IA local resuelve de raíz.

Evolución de la capacidad de inferencia en formato Mini

| Año | Hardware típico | Capacidad de modelo | Velocidad promedio (tok/s) |

|---|---|---|---|

| 2024 | Ryzen 7000 / Intel 14th Gen | 7B – 13B (Quantized) | 5 – 12 |

| 2025 | Ryzen 8000 / M4 Base | 13B – 34B | 15 – 30 |

| 2026 | Strix Halo / M5 Pro / DGX Spark | 34B – 120B+ | 30 – 60+ |

La variable crítica: RAM y ancho de banda

En IA local, la memoria RAM supera en importancia a la velocidad del procesador. La cantidad de RAM define qué modelo puedes cargar; el ancho de banda determina qué tan rápido genera tokens.

Los cuatro niveles de memoria en 2026:

- 16 GB: mínimo absoluto. Modelos 3B-7B, tareas básicas de chat y resúmenes.

- 32 GB: el “punto dulce” para desarrolladores. Phi-4 y Llama cuantizado sin sacrificar otras aplicaciones abiertas.

- 64 GB: estándar profesional. Modelos 30B-34B a velocidad de conversación real, ideal para agentes con múltiples fuentes de datos.

- 128 GB: territorio de servidor. Llama 70B y superiores, compitiendo con estaciones de trabajo de torre a una fracción del espacio.

Para entender el rol específico de las NPUs en este ecosistema, nuestro análisis TPU vs NPU en 2026 explica por qué el silicio especializado importa más que los GHz en el contexto de inferencia local.

Guía de compra por presupuesto

Nivel 1: Entrada y experimentación (menos de $400)

Para estudiantes, automatización doméstica y exploración sin compromiso financiero.

Beelink Mini S12 Pro (Intel N100, 16 GB DDR4, ~$220): genera 6-9 tok/s con modelos 7B. Consume 12-18W. Ideal como servidor ligero encendido 24/7.

Raspberry Pi 5 con 8 GB: rendimiento limitado (3-5 tok/s con modelos 2B), pero su ecosistema permite integraciones en robótica y domótica que ninguna Mini PC convencional facilita.

Nivel 2: Gama media, el punto de inflexión real ($400 – $900)

Aquí está la verdadera democratización. Las iGPUs Radeon 780M y 890M cambiaron la ecuación.

Beelink EQR6 (Ryzen 7 8845HS, hasta 64 GB DDR5, ~$400-$600): alcanza 18-25 tok/s con Llama 3 8B. La mejor relación precio/rendimiento del mercado en este rango.

Mac Mini M4 (16-24 GB memoria unificada): la opción “plug-and-play” del segmento. Su arquitectura de memoria unificada supera en eficiencia de inferencia a máquinas Windows con más RAM nominal. Silencioso, sin fricción de configuración.

| Modelo | Procesador | Memoria recomendada | Fortalezas |

|---|---|---|---|

| Beelink EQR6 | Ryzen 7 7735/8845 | 32 GB DDR5 | Precio/rendimiento, LAN dual |

| Mac Mini M4 | Apple M4 | 24 GB Unified | Eficiencia, silencio, macOS |

| ASUS NUC 15 Pro | Core Ultra Series 2 | 32 GB LPDDR5x | Fiabilidad empresarial, NPU dedicada |

Nivel 3: Gama alta profesional ($1.000 – $1.800)

Cuando se trabaja con modelos de razonamiento avanzado clase 30B-34B, el salto se justifica.

Beelink SER10 Max (Ryzen AI 9 HX 470, 64 GB DDR5): 86 TOPS combinados. Con DeepSeek V4 33B (Q4) alcanza 10-14 tok/s, suficiente para flujos de trabajo de programación y análisis de datos complejos.

Mac Mini M4 Pro con 48 GB: según la mayoría de expertos, la mejor opción de valor 2026 para profesionales. Modelos 30B a 12-18 tok/s. La llegada del M5 Pro a mediados de año promete 300 GB/s de ancho de banda de memoria y una reducción adicional de latencia percibida.

Nivel 4: Rendimiento extremo, el servidor de IA de bolsillo

Beelink GTR9 Pro (Ryzen AI Max+ 395, 128 GB LPDDR5X, iGPU Radeon 8060S con hasta 96 GB de VRAM asignada): 126 TOPS. Ejecuta Llama 3.3 70B (Q4) con fluidez real. Cabe en una mochila, rinde como un servidor de rack.

TiinyAI Pocket Lab (~$1.399): 80 GB de RAM, 190 TOPS, arquitectura SoC + NPU dedicada. Consume 30-65W. Ejecuta modelos de 120B parámetros totalmente offline. La sorpresa disruptiva del año.

NVIDIA DGX Spark: la “supercomputadora de IA más pequeña del mundo” según NVIDIA. Diseñada para escalar agentes autónomos, es la preferida de laboratorios universitarios que necesitan compatibilidad total con el ecosistema CUDA. Contexto completo sobre el peso de NVIDIA en este mercado en nuestro análisis de por qué NVIDIA es el nuevo valor mundial.

Conectividad: el triunfo de OCuLink

Para quienes planean expandir su Mini PC con una eGPU, la elección de interfaz importa más que el precio de la GPU.

- USB4 / Thunderbolt 5: válidos para productividad general. Latencia aceptable.

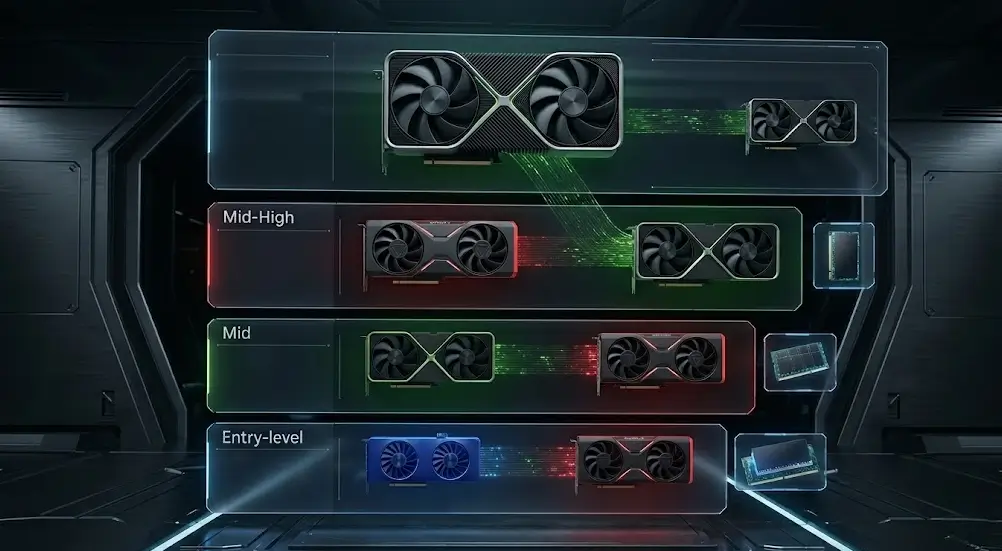

- OCuLink (PCIe 4.0 x4/x8): el estándar de facto para IA en 2026. Elimina los cuellos de botella que afectaban a las eGPUs en generaciones anteriores. Permite conectar una RTX 5080 o 5090 con rendimiento comparable a una PC de escritorio de tamaño completo. Para entender el ecosistema completo de conectividad, nuestro artículo sobre USB4 y Thunderbolt 5 es el punto de referencia.

- CopprLink (PCIe 5.0): emerge en estaciones mini de grado servidor, con hasta 64 GB/s para mover modelos masivos entre RAM y GPU casi instantáneamente.

Software: la otra mitad de la ecuación

El hardware es el punto de partida. En 2026, herramientas como Ollama, LM Studio y Tiiny OS han eliminado la necesidad de terminal para la mayoría de usuarios. La curva de adopción de la IA local ha colapsado.

El cambio más relevante es la integración de Model Context Protocol (MCP): permite que los modelos locales accedan de forma segura a herramientas internas, bases de datos y APIs, construyendo flujos de trabajo autónomos sin intervención humana constante.

Esto convierte la Mini PC en un nodo de inteligencia privado y persistente, no solo en un chat offline. Un caso de uso concreto que ilustra este potencial está en nuestro artículo sobre Tu PC como servidor de IA.

Eficiencia térmica y energética

La inferencia pesada mantiene CPU e iGPU al 100% durante periodos prolongados. En 2026, este es un problema mayoritariamente resuelto:

| Dispositivo | Consumo sistema | Capacidad de modelo | Eficiencia |

|---|---|---|---|

| TiinyAI Pocket Lab | 30W – 65W | 120B | Máxima |

| Mac Mini M4 Pro | ~65W carga total | 34B | Alta |

| Beelink GTR9 Pro | 65W – 100W | 70B+ | Media-Alta |

| Mini PC N100 | 12W – 18W | 7B (lento) | Media |

Mac Mini y Mac Studio mantienen rendimiento máximo en silencio absoluto. El GMKtec EVO-T1 y el Geekom A9 Max han integrado cámaras de vapor para eliminar el thermal throttling.

El TiinyAI Pocket Lab sorprende por mantenerse frío tras horas de uso continuo, gracias a la eficiencia de ARMv9.2 y NPUs dedicadas, un tema que desarrollamos en profundidad en nuestro análisis de arquitecturas post-NPU para 2026.

Preguntas Frecuentes

Los servicios en la nube utilizan miles de GPUs en paralelo. Tu Mini PC es un sistema individual. Con hardware como el Mac Mini M4 Pro o el Ryzen AI 9, la diferencia de velocidad en modelos medianos es casi imperceptible en uso real, con la ventaja de privacidad total.

RAM primero, siempre. Sin memoria suficiente, el modelo no carga. La NPU y la iGPU aceleran la inferencia una vez que el modelo está en memoria. Prioriza 32 GB mínimo antes de buscar el procesador más rápido.

Las Mini PC están optimizadas para inferencia. Para entrenamiento completo de modelos grandes se requiere VRAM que solo ofrecen GPUs NVIDIA de gama alta en PC de escritorio. Sin embargo, el fine-tuning de modelos pequeños es perfectamente viable en el Beelink GTR9 Pro o el TiinyAI Pocket Lab.

Linux (Ubuntu) ofrece la mayor compatibilidad con herramientas de IA y drivers de GPU. macOS es excelente por la gestión de memoria unificada y la facilidad de configuración. Windows es funcional pero genera más fricción técnica en configuraciones avanzadas.

Si necesitas la capacidad hoy, el M4 Pro y los Ryzen AI 9 actuales son sólidos. Si tu enfoque es agentes autónomos de alta exigencia y buscas máxima eficiencia en ancho de banda, el M5 Pro y Panther Lake (segunda mitad de 2026) representan un salto que puede justificar la espera.